Un’inquietante indagine condotta dai laboratori di ricerca sulla sicurezza CovertLabs ha scoperchiato un vero e proprio vaso di Pandora digitale all’interno dell’App Store di Apple.

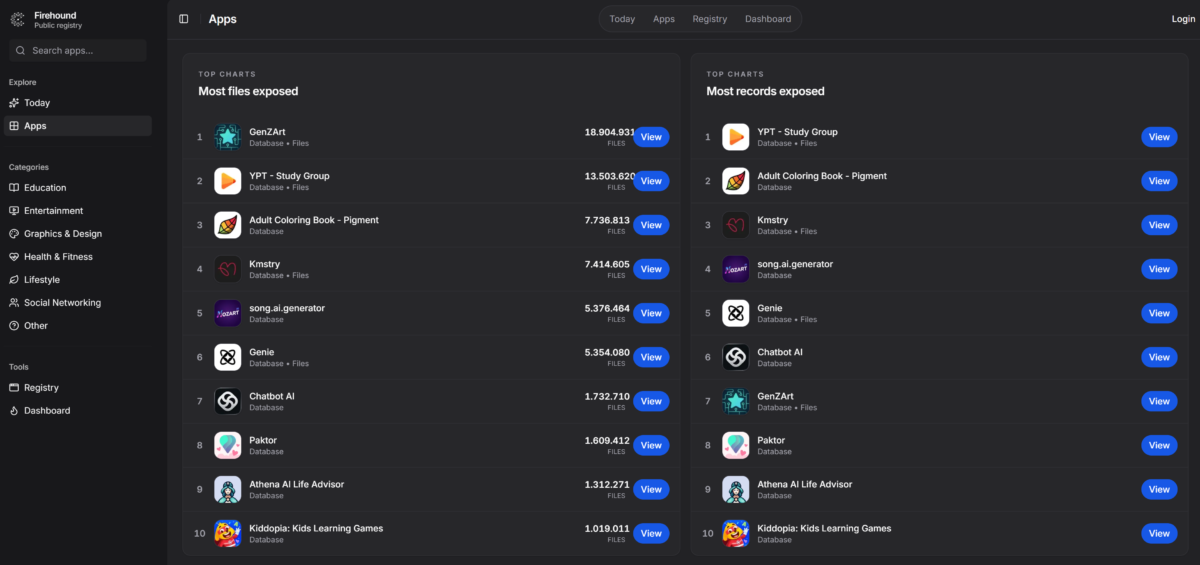

Attraverso un progetto denominato Firehound, i ricercatori stanno attivamente scansionando e indicizzando un vasto numero di applicazioni che, a causa di gravi negligenze nello sviluppo, espongono pubblicamente i dati sensibili dei propri utenti.

Al momento della stesura di questo rapporto, sono state identificate ben 198 applicazioni iOS vulnerabili, la quasi totalità delle quali lascia trapelare informazioni critiche come nomi, indirizzi email, numeri di telefono e, fatto ancora più allarmante, intere cronologie di chat.

Firehound è lo store che classifica le app da evitare assolutamente

La punta dell’iceberg di questa crisi di sicurezza è rappresentata da un’applicazione specifica che domina le classifiche negative del progetto Firehound: Chat & Ask AI.

Le scoperte relative a questo software sono state descritte dal ricercatore Harrison come uno scenario “della peggior specie“. L’applicazione in questione ha esposto oltre 406 milioni di record appartenenti a più di 18 milioni di utenti ignari.

La gravità della situazione è stata sottolineata con urgenza su X (ex Twitter), dove è stato lanciato un appello perentorio a cessare immediatamente l’utilizzo dell’app. Secondo l’analisi tecnica, una vulnerabilità critica permette a chiunque sappia dove guardare di accedere a circa 380 milioni di messaggi.

Non si tratta di semplici metadati, ma del contenuto testuale delle conversazioni che gli utenti hanno intrattenuto con l’intelligenza artificiale.

Considerando la natura spesso intima delle interazioni con i chatbot AI, questi archivi contengono confessioni su problemi di salute mentale, difficoltà relazionali, questioni finanziarie e dubbi medici. Sono informazioni che la maggior parte delle persone non rivelerebbe nemmeno a un amico stretto, ora potenzialmente collegate pubblicamente a email e numeri di telefono degli utenti.

L’invasione dell’AI Slop e le falle sistemiche

Il fenomeno non è isolato, ma sembra essere sintomatico di quella che gli esperti di sicurezza, tra cui l’account @vxunderground, hanno battezzato “slopocalypse“.

Questo termine indica l’ondata di software di bassa qualità, spesso generati rapidamente tramite strumenti di codifica assistita dall’intelligenza artificiale (il cosiddetto “vibe coding”) o sviluppati autonomamente senza i necessari controlli di sicurezza, che sta inondando gli store digitali.

Sebbene la maggior parte delle 196 app confermate come “leaking” (ovvero che perdono dati) siano legate al mondo dell’intelligenza artificiale, il problema è trasversale.

L’indagine ha rilevato vulnerabilità simili in applicazioni dedicate all’istruzione, all’intrattenimento, alla grafica, alla salute e al fitness, oltre che ai social network e allo stile di vita. Il denominatore comune di queste falle di sicurezza risiede quasi sempre in database configurati in modo improprio o in servizi di cloud storage lasciati privi di protezioni, che espongono gli schemi dei dati e i record ivi contenuti a chiunque effettui una scansione di rete.

Un registro pubblico ma protetto

Per gestire questa mole di dati sensibili in modo responsabile, il progetto Firehound ha adottato un approccio cauto. Nonostante l’obiettivo sia quello di catalogare e denunciare le app insicure, il registro pubblico è stato intenzionalmente limitato.

I risultati delle scansioni contengono informazioni altamente sensibili che non possono essere divulgate indiscriminatamente senza prima essere state revisionate e oscurate.

Per questo motivo, l’accesso ai dataset completi e ai dettagli tecnici delle vulnerabilità è limitato e richiede una registrazione approvata manualmente.

La priorità per l’accesso viene garantita a giornalisti, forze dell’ordine e professionisti della sicurezza informatica, nel tentativo di mitigare il rischio che attori malintenzionati possano sfruttare queste informazioni prima che gli sviluppatori abbiano il tempo di porvi rimedio.

La necessità di una nuova consapevolezza

Questa scoperta serve da severo monito per l’intero ecosistema mobile.

Da un lato, sottolinea la necessità per gli utenti di prestare estrema attenzione alle piattaforme utilizzate, specialmente quando si condividono pensieri intimi con chatbot AI, partendo dal presupposto che la barriera d’ingresso per creare un’app si è abbassata drasticamente, spesso a discapito della sicurezza.

Dall’altro, pone l’accento sulla responsabilità degli sviluppatori, i quali devono essere chiamati a rispondere di negligenze che mettono a rischio la privacy di milioni di persone.

Come ribadito dai ricercatori, l’uso di strumenti di sviluppo autonomi non esime nessuno dal dovere di proteggere adeguatamente i dati degli utenti.